En cuanto nos levantamos de la cama, es evidente que el cerebro empieza a funcionar. Y lo hace de una manera arrolladora, poniendo en marcha una gran cantidad de recursos y energía que podría llegar a dejarnos anonadados. Sin embargo, también es cierto que todavía será necesario trabajar hasta conocer cómo funciona, por ejemplo, este órgano del cuerpo.

En primer lugar, tenemos que saber que, gracias a un estudio realizado en la Universidad de Georgetown, hemos podido conocer que, aunque veamos palabras, lo que hace el cerebro es interpretarlo todo como imágenes. Digamos adiós a los conjuntos de letras, ya que el órgano lo mira de otra manera completamente diferente, aunque el resultado al final sea más o menos el mismo.

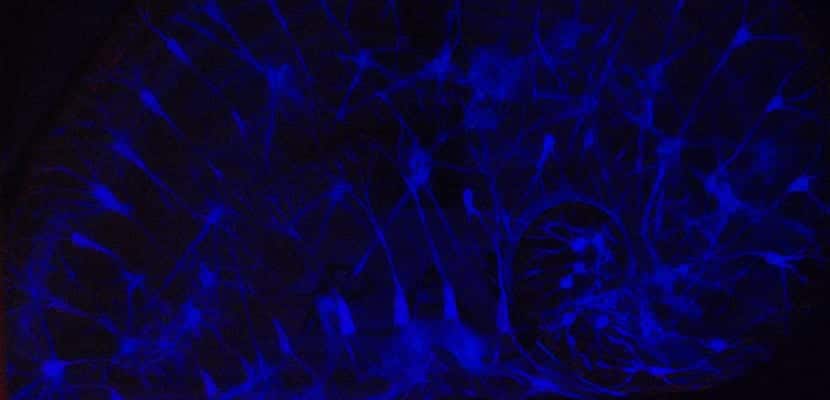

Podría parecer una tontería, pero todo es mucho más interesante. AL actuar de esta manera, el cerebro sintoniza las neuronas para responder a una palabra completa, además de que las mismas dan diferentes respuestas en función de que las palabras sean reales o no. En otras palabras, el cerebro reacciona ante los diferentes contenidos que se encuentra, lo que podría ayudar a acelerar el aprendizaje y ayudar a que estudiemos más.

La próxima vez que estudiéis, ya sabéis lo que está sucediendo en vuestro cerebro. El mismo no reconoce las palabras como conjuntos de letras, sino como imágenes. Y al asociar los términos de diferentes formas, también tendréis la oportunidad de aprender más rápido.

De todas formas, no dejaremos de prestarle atención a los estudios que haya sobre el cerebro. En el caso de que sepamos potenciarlo de manera adecuada, tendremos la oportunidad de aprender mucho más. Y mejor.